PRIMEROS

ACELERADORES

Los aceleradores y los detectores de partículas son los

microscopios que permiten adentrarse en lo más profundo de la materia. La

sonda o proyectil es una partícula dotada de la energía necesaria para que

su longitud de onda sea comparable al tamaño de los detalles que se

quieran estudiar. Cuanto más grande sea la energía de la sonda, menor será

su longitud de onda, tal y como se puede deducir de la relación de De

Broglie.

La naturaleza pone a nuestro alcance diversos tipos de

proyectiles, algunos de energía muy grande. Por ejemplo, las partículas

emitidas por ciertos elementos radiactivos pueden tener energías hasta

unos pocos MeV(1). Lanzando estos

proyectiles sobre los átomos se descubrió la existencia de los núcleos,

que tienen dimensiones del orden del fermio o del femtómetro (10-15 m). Para conocer

la estructura de las partículas elementales es necesario disponer de

energías superiores al GeV.

La radiación cósmica contiene partículas con

energías que pueden llegar a 1020 eV, una energía

enorme que es un millón de veces la energía alcanzada en los aceleradores

actuales. Pero los rayos cósmicos tienen muchos inconvenientes para ser

usados como proyectiles: tipos de partículas desconocidas, intensidad

débil, gran dispersión en energía... Por esta razón a principios de los

años treinta se construyeron los primeros aceleradores de partículas, para

obtener haces intensos y controlables de proyectiles con una energía

desconocida.

El progreso realizado desde entonces ha sido considerable.

Además, concentran una gran cantidad de energía en un pequeño volumen, y

ésta se puede materializar en nuevas partículas: es una consecuencia de la

famosa ecuación de Einstein E=mc2. En este

sentido, los “microscopios” a los que nos referíamos son un poco

especiales: muy a menudo se trata de destruir las estructuras, creando

otras nuevas para profundizar en la estructura íntima de la

materia.

Los aceleradores más sencillos son los electrostáticos,

que se basan en la aplicación de una diferencia de potencial entre una

fuente de partículas cargadas y un blanco fijo. El primero de estos

aceleradores se construyó en 1932, y aceleraba iones pesados hasta 600

KeV. Un gran número de este tipo de aceleradores todavía están hoy en

servicio y su principal mérito es acelerar cualquier tipo de partícula

cargada con una pequeña dispersión de energía. Su límite estriba en la

alta tensión, a causa de los fenómenos de descarga. Este inconveniente

desaparece utilizando para acelerar un campo eléctrico variable de alta

frecuencia o de radiofrecuencia sobre la trayectoria que recorre la

partícula. Es lo que se conoce con el nombre de acelerador lineal

basado en campos de radiofrecuencia. El primero, construido en el

año 1931, aceleró iones de mercurio a 1.26 MeV.

Esta tecnología estaba

limitada en la época porque no se podían alcanzar altas frecuencias. Pero

la puesta a punto del radar en la Segunda Guerra Mundial dio acceso a

frecuencias más elevadas. En 1948 se construyó un acelerador lineal de

protones a 32 MeV utilizando frecuencias de 200 MHz. Desde entonces las

frecuencias no han hecho sino aumentar. Este campo eléctrico de alta

frecuencia está pulsado para limitar la frecuencia máxima deseada. El haz

procedente de un acelerador lineal será por tanto pulsado. En la

actualidad se utilizan sobre todo como inyectores de otros aceleradores.

El mismo año 1932 aparecieron los aceleradores circulares. En el

ciclotrón se utiliza un campo magnético uniforme e independiente

del tiempo para acelerar partículas cargadas, que se mueven en un plano

perpendicular al campo magnético describiendo una espiral, cuyo radio

aumenta con la energía. Los ciclotrones producen un haz continuo, pero su

energía está limitada a una pequeña fracción de la masa de los

proyectiles. Actualmente son los aceleradores más utilizados en medicina,

pero se han abandonado para la investigación en física. El problema es que

la trayectoria de las partículas es una espiral, cuyo radio aumenta cada

vez más, por lo que es necesario un campo magnético en un volumen cada vez

mayor. La alternativa es utilizar electroimanes, repartidos a lo largo de

la trayectoria, para dar una aceleración centrípeta a las partículas y

mantenerlas en una órbita cerrada. El primer sincrotón se construyó

en 1952, y aceleraba partículas hasta 3 GeV. En la actualidad se llegan a

energías de 1 TeV por protón.

En los dos tipos de aceleradores

considerados, el blanco está siempre fijo. La energía disponible para la

creación de nuevas partículas es una pequeña fracción de la energía del

proyectil, mientras que el resto se manifiesta en forma de energía

cinética después de la colisión. Se puede ganar mucha más energía si el

blanco está también en movimiento y si la colisión es frontal o casi

frontal. Este nuevo tipo de aceleradores se llama colisionador, y

es el que se utiliza actualmente en física de altas energías. Para dos

partículas de igual masa y energía se puede doblar la energía de la

colisión. Por ejemplo, un colisionador protón-antiprotón de 630 GeV es

equivalente a un sincrotón de protones de blanco fijo de 212 TeV. En el

CERN está instalado el LEP (Large Electronic Positron). Comenzó a

funcionar en el 1989 haciendo colisionar electrones y positrones a 45 GeV

por haz. La energía ha ido aumentando hasta los actuales 103 GeV por haz.

A finales del 2000 se desmanteló para ubicar en su túnel el nuevo LHC

(Large Hadron Collider) donde se producirán colisiones protón-protón a 7

TeV por haz. Desafortunadamente, aumento de energía significa también

aumento de tamaño y por tanto aumento de costos.

Los primeros ciclotrones

eran pequeños, y su inventor construyó incluso uno de demostración que le

cabía en una mano. Se puede observar en una vista aérea de

los alrededores del CERN, con el dibujo de una circunferencia de unos 27

km, que corresponde al LEP. El nivel tecnológico necesario para

desarrollar estos aceleradores es cada vez más alto. En el caso del LHC

todos los imanes serán superconductores que llegarán a campos magnéticos

de 9 teslas. Eso hará que el tipo de funcionamiento sea totalmente

diferente del LEP, donde sólo una pequeña parte de los imanes son

superconductores.

Por otra parte, se debe decir que de este nivel se

beneficia tanto la industria como la sociedad en general. El ejemplo más

significativo es el de la World Wide Web, que nació como un medio de

comunicación para los físicos y que hoy utiliza todo el mundo. Aunque

parezca increíble, este gran aparato es muy sensible a efectos externos

insospechados. Por ejemplo, el paso de los trenes de alta velocidad o

incluso las mareas lunares se deben tener en cuenta para calibrar y

controlar la energía de las partículas.

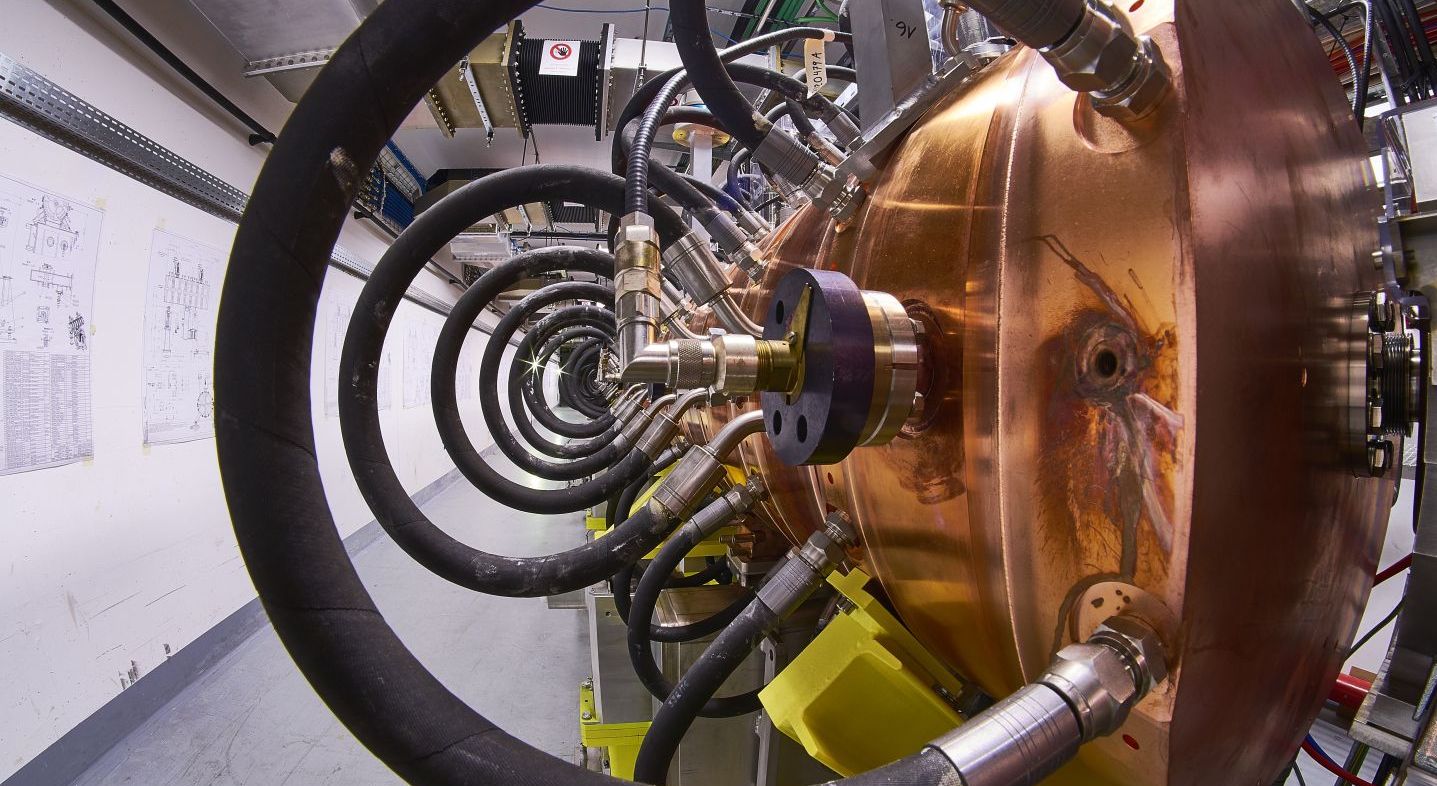

Antes de entrar en un

acelerador como el LEP, las partículas salen de una

fuente de iones, electrones, positrones o protones, y pasan por los

sistemas de inyección que las aceleran antes de entrar en la cámara de

vacío. Esta es como una cañería por la cual circulan las partículas. Se

tiene que hacer el vacío para evitar que las partículas aceleradas

colisionen con las partículas del aire. El vacío es de 10-9 torr, comparable al

vacío lunar. La cámara está rodeada de un campo magnético guía que hace

que las partículas giren en una órbita cerrada, y por un campo focalizador

para que se mantengan alrededor de la órbita ideal, para lo que deben

hacer oscilaciones laterales (radiales y verticales).

Toda partícula

cargada pierde energía al ser sometida a una aceleración. Así, en cada

revolución la partícula pierde una fracción de su energía en forma de luz:

es lo que se conoce como radiación sincrotón, de la que volveremos a

hablar al final de este ensayo. Esta pérdida indeseable de energía,

inversamente proporcional a la masa de la partícula acelerada, se debe

compensar cada vez con cavidades de radiofrecuencia. Lo que se hace es dar

una aceleración periódica que agrupa las partículas en paquetes, haciendo

que oscilen también longitudinalmente. Las partículas circulan en haces

formados por uno o más paquetes, con una velocidad próxima a la de la luz

en el vacío, oscilando en todas las direcciones y emitiendo radiación

sincrotón. Para las oscilaciones transversales, la amplitud de las

oscilaciones viene dada por las dimensiones de la cámara de vacío.

Así

pues, una partícula no viaja sola, sino que lo hace en paquetes, en

compañía de unas 109 partículas idénticas

en un volumen de un milímetro cúbico aproximadamente. Si todas las

partículas tienen cargas del mismo signo, la repulsión electrostática se

opone a mantenerlas en un volumen pequeño. Afortunadamente, para altas

energías próximas al GeV los efectos relativistas dominan y esta repulsión

desaparece.

Otro problema técnico es que la cámara de vacío es metálica.

Por eso, cada partícula cargada del paquete produce un campo magnético en

el metal que perturbará el movimiento de los otros paquetes de partículas

almacenadas que vengan detrás. Este efecto es similar al que experimenta

un barco cuando sigue la estela de otro, y como en este caso todas las

partículas oscilan colectivamente con una amplitud que aumenta rápidamente

con el tiempo, se debe actuar con mecanismos para controlar y suprimir

estas oscilaciones perturbadoras. En un colisionador como el LEP, circulan

por la cámara de vacío electrones y positrones que, por tanto, siguen

direcciones opuestas. Y aquí viene la parte más interesante: ¿Cómo hacer

que choquen? Los haces se mantienen en las órbitas ideales, y se hacen

coincidir en ciertos puntos de interacción que es donde se colocan los

detectores. Contrariamente a lo que se puede pensar, es difícil hacer que

colisionen: los paquetes de electrones y positrones se cruzan sin sentir

más que una distorsión mutua que modifica las órbitas respectivas.

Este

efecto es importante a densidades de corriente altas y limita lo que se

denomina la luminosidad del haz y por tanto el número de interacciones que

se pueden producir. Ocasionalmente, en cada cruce de haces, un electrón

llega a estar tan cerca de un positrón que se produce la colisión, hecho

que da lugar a una dispersión, como si se tratara de dos bolas de billar,

o bien produciendo una aniquilación que produzca nuevas partículas. La

parte más delicada es, por tanto, conseguir el máximo de colisiones en las

zonas diseñadas, donde los detectores recogerán los productos de la

colisión. En el futuro acelerador LHC se harán chocar dos haces de

protones, por lo que se han de construir dos cámaras de vacío diferentes,

haciendo que en cada una los protones viajen en sentido contrario, y

estableciendo puntos de cruce entre los dos haces.

Como ya hemos

advertido, los aceleradores circulares tienen un efecto no deseado por los

primeros usuarios: la energía de las partículas aceleradas se pierde en

forma de radiación sincrotón. Esta pérdida consiste en un haz de

luz muy intenso, emitido hacia delante en un cono que tiene un ángulo de

abertura de una decenas de microradianes, distribuido en un continuo de

longitudes de onda, desde el infrarrojo lejano hasta la región de los

rayos X, polarizado en el plano de la órbita y con un brillo que supera el

de las fuentes convencionales en un factor superior a 108. Como la luz es la sonda

más utilizada en el estudio de la materia en prácticamente todas las

disciplinas científicas, no es sorprendente que esta “pérdida” se haya

convertido en un instrumento esencial para la investigación fundamental y

que se aplique en campos muy diferentes. Por eso cerraremos este artículo

con unas referencias no exhaustivas a estas aplicaciones.

Para dar una

idea de su importancia, digamos que hoy en día los usuarios de la luz de

sincrotón ya no utilizan parasitariamente los aceleradores de la física

nuclear, sino que han construido sincrotones dedicados exclusivamente a la

producción de luz. Todos lo países avanzados (y no tan avanzados) tienen

fuentes propias y participan en proyectos de cobertura continental. Un

vistazo a la distribución europea de fuentes de luz sincrotón muestra que

al sur de la línea que une París (Francia) con Trieste (Italia), no hay

ninguna fuente nacional, hecho que muestra la urgente necesidad de

construir una. La radiación sincrotón es actualmente un instrumento

imprescindible en campos tan diversos como la investigación avanzada en

cosmética y en industria de los alimentos; en catalizadores y en problemas

de contaminación; en fibras artificiales y en productos farmacéuticos; en

microelectrónica y en micromecánica.

La lista de ejemplos no se acaba,

pero con estos ya puede verse que la capacidad de la radiación sincrotón

va mucho más allá de ser un instrumento para la pura investigación

aplicada. El acceso fácil a una fuente de luz sincrotón es imprescindible

en cualquier campo de investigación competitiva como la que practican los

países de nuestro entorno.

Por citar algún ejemplo de aplicación en

ciencia básica, nos referiremos solamente a la biología. La radiación

sincrotón ha permitido estudiar los cambios conformacionales de

macromoléculas biológicas en disolución, empleando técnicas de dispersión

de rayos X con resolución temporal, dada la estructura temporal de esta

radiación. Un campo en expansión es el relacionado con complejos

biológicos que forman estructuras bidimensionales, como las membranas; los

experimentos de difracción de rayos X a ángulos pequeños proporcionan

información directa sobre la dinámica estructural de estos sistemas en

funcionamiento, por ejemplo cuando transportan iones o pequeñas moléculas

a través de una membrana.

Consideraciones similares se pueden hacer en el

caso de los estudios de dinámica estructural de muchas otras moléculas

fibrosas, como el DNA o el tejido muscular. Un ejemplo espectacular de la

potencia de la radiación sincrotón es la manera como ha transformado la

solución de la estructura atómica de sistemas biológicos usando cristales

de moléculas macrobiológicas. La resolución de una estructura necesitaba

años de trabajo, mientras que ahora las técnicas de radiación sincrotón

permiten hacerlo, de manera casi rutinaria, en cuestión de horas. Este

enorme progreso, después de la finalización del proyecto del genoma

humano, permite contemplar de forma realista el paso al siguiente reto

científico: la determinación de la estructura de aproximadamente las

100.000 proteínas codificadas del genoma humano. Esta disciplina, que

ahora se conoce como la “proteónica”, es probable que se convierta en una

de las grandes conquistas del siglo XXI y la radiación sincrotón será uno

de los instrumentos centrales e indispensables para su éxito: El futuro de

la radiación sincrotón como instrumento de investigación será tan

brillante como la intensidad de sus propias fuentes.