LAS CAJAS DE EINSTEIN

La física del siglo XX se sustenta sobre dos pilares: la teoría de la relatividad y la mecánica cuántica. La primera obra casi exclusiva de Albert Einstein, describe los fenómenos naturales en los que están involucradas velocidades cercanas a la de la luz. La segunda, en cuya formulación participó una pléyade de grandes físicos de principios del siglo XX, es la mecánica del mundo de los átomos y las partículas que los constituyen. Así como la teoría de la relatividad introdujo conceptos que chocaron con el sentido común, la mecánica cuántica expuso una descripción del mundo microscópico que en nada se parecía al de la experiencia diaria. De acuerdo con la mecánica cuántica, las partículas atómicas no se comportan como los objetos del mundo macroscópico, sino que tienen propiedades a la vez de partículas y de ondas.

Una partícula con esta característica: el fotón, que a veces se manifiesta como onda y a veces como partícula. Esta es una propiedad de todas las partículas elementales, electrones, protones, neutrones, etc. que constituyen los átomos, por lo que los fenómenos en ese nivel se producen de acuerdo a leyes muy peculiares. Por principio de cuentas, es imposible caracterizar una partícula elemental por su posición y su velocidad, tal como ocurre en la física newtoniana. Al contrario, en la mecánica cuántica sólo se puede calcular la probabilidad de encontrar una partícula en cierto estado físico. Tal probabilidad se obtiene a partir de una expresión matemática, la función de onda.

En la mecánica newtoniana se calcula la posición y la velocidad de una partícula a partir de ecuaciones matemáticas, que relacionan el movimiento de la partícula con la fuerza que se le aplica de acuerdo con la segunda ley de Newton (fuerza = masa x aceleración). En cambio, en la mecánica cuántica se calcula la probabilidad de encontrar una partícula en cierto estado físico, utilizando ecuaciones matemáticas, en particular la ecuación deducida por el físico alemán Erwin Schrödinger en 1926, que relaciona la función de onda de la partícula con la fuerza aplicada sobre ella. Gracias a esta ecuación, los físicos lograron resolver un gran número de problemas relacionados con los átomos y las partículas que los componen. Un nuevo nivel de la realidad se había revelado, donde regían leyes totalmente distintas las de nuestro mundo macroscópico.

La ecuación de Schrödinger tiene un rango de validez muy amplio, pero restringido a fenómenos en los que no se involucran velocidades cercanas a la de la luz. La mecánica cuántica nació como una extensión de la mecánica newtoniana al mundo atómico y, por ello precisamente llevaba inherentes las limitaciones básicas de ésta. En los años treinta, los fenómenos relativistas aún no tenían cabida en la nueva física cuántica. Era necesario, pues, unir la mecánica cuántica y la relatividad.

Dirac y el anti-mundo

La ecuación de Schrödinger es compatible con el principio de relatividad de Galileo, pues está basada en los principios de la mecánica newtoniana. Generalizar esa ecuación para hacerla compatible con la relatividad de Einstein no parecía, en principio, demasiado difícil. Ya en 1926, los físicos Klein y Gordon propusieron una ecuación con esas características que tenía una forma matemática relativamente simple, mas no describía adecuadamente los fenómenos cuánticos. Uno de sus principales defectos era que las partículas supuestamente descritas podían poseer cualquier energía, incluso negativa; como todo cuerpo en la naturaleza tiende a pasar, cuando se le deja libre, de un estado de mayor energía a otro de menor energía, resultaría que todas las partículas del Universo tenderían a un estado con energía infinitamente negativa, como si cayeran en un pozo sin fondo.

Evidentemente, una ecuación que predice tal comportamiento no puede corresponder al mundo real. El problema de unir adecuadamente la mecánica cuántica y la teoría de la relatividad parecía estancado hasta que, en 1930, el físico inglés Paul Adrian Maurice Dirac logró deducir una ecuación que describe adecuadamente los fenómenos cuánticos y es compatible con el principio de la relatividad. Si existe algo así como una estética matemática, la ecuación de Dirac es una verdadera obra de arte, por la manera tan ingeniosa con la que el físico inglés resolvió un problemaaparentemente irresoluble. La ecuación de Dirac permite calcular la función de onda de un electrón, y de otras partículas elementales, tomando en cuenta todos los efectos relativistas. Sin embargo, adolecía del mismo defecto que mencionamos anteriormente: de acuerdo con esta ecuación, un electrón podía tener una energía infinitamente negativa. Pero lo que parecía una dificultad técnica resultó ser, gracias al ingenio de Dirac, la clave para descubrir un aspecto insospechado de la Naturaleza.

Para evitar que todos los electrones del Universo cayeran a estados con energías infinitamente negativas, Dirac propuso que todos los estados con energía negativa estaban ocupados ya por electrones, aunque éstos no se puedan detectar directamente (¡el vacío de la mecánica cuántica resulta ser un mar infinito de partículas!, y esta aparente contradicción es todavía uno de los problemas más complejos de la física moderna). Pero si llegara a faltar uno de estos electrones de energía negativa, su ausencia, se detectaría como la presencia de una partícula con energía positiva y con la carga eléctrica contraria a la del electrón. Esa nueva partícula, predijo Dirac, sería un electrón; tendría la misma masa que un electrón y todas las demás propiedades, excepto el signo de la carga eléctrica, que sería positivo, razón por la que esa nueva partícula fue bautizada positrón. Más aún, Dirac predijo, con base en su modelo, que al ponerse en contacto un electrón con un positrón los dos se aniquilarían, transformando la totalidad de sus masas en energía en forma de dos rayos gamma (fotones de altísima energía). Además, el argumento de Dirac podía aplicarse a cualquier partícula, por lo que predecía que existen en la Naturaleza antiprotones, antineutrones, e incluso antiátomos, compuestos de positrones y anti-núcleos.

La hipótesis de Dirac fue confirmada definitivamente poco tiempo después de haber sido formulada. En 1932, se detectaron positrones en el flujo de rayos cósmicos que llegan a la superficie terrestre, con las características predichas por la teoría: carga positiva y misma masa que los electrones. Incluso se descubrió posteriormente que algunos elementos radiactivos emiten positrones al decaer sus núcleos. Y en los años cincuenta, cuando empezaron a funcionar los grandes aceleradores de partículas para estudiar el mundo subatómico, se logró producir antiprotones, antineutrones y todo tipo de antipartículas.

Con las antipartículas se pueden formar, en principio, antiátomos, anti-moléculas e incluso anti-mundos, estrellas y planetas, habitados por seres de antimateria. Los fenómenos naturales en esos anti-mundos serían idénticos a los que conocemos, con la única diferencia que el signo de todas las partículas atómicas estaría invertido; esto se debe a que las leyes de la física son (casi) iguales para la materia y la antimateria. La apariencia visual de estos anti-mundos sería indistinguible de un mundo de materia, pues la luz (y en general los fenómenos electromagnéticos) no hace distinción entre materia y antimateria. Pero si un día nos visitara un ser de antimateria las consecuencias serían catastróficas para todos: se aniquilaría totalmente al pisar tierra, produciendo una explosión mucho más fuerte que una bomba atómica.

El mecanismo más eficiente que existe en la Naturaleza para transformar masa en energía es la aniquilación de la materia con la antimateria; la eficiencia del proceso es del 100%, pues la totalidad de la masa se convierte en energía en forma de rayos gamma. Desgraciadamente, no es un proceso aprovechable para usos prácticos pues no existen yacimientos de antimateria en la Tierra: se pueden producir antipartículas en los aceleradores de partículas, a costa de invertir enormes cantidades de energía, pero es imposible almacenarlas, pues se aniquilan al menor contacto con la materia.

Las partículas (y antipartículas) elementales

A pesar de lo que indica su nombre, un átomo no es indivisible, sino que está constituido por electrones, que giran alrededor de un núcleo formado por protones y neutrones. Al principio, los físicos pensaron que los elementos básicos del Universo eran estas tres partículas: electrón, protón y neutrón, y la partícula de la luz: el fotón. Pero él número de las partículas supuestamente elementales empezó a aumentar, primero lentamente y después, en forma alarmante... Primero, con la teoría Dirac, aparecieron en la escena los positrones, los antiprotones y los antineutrones. Incluso una partícula eléctricamente neutra como el neutrón tiene su antipartícula correspondiente. ¿Cómo distinguir un neutrón de un antineutrón, si no tienen carga eléctrica que los diferencie? La manera más simple es ponerlos en contacto: se aniquilan mutuamente produciendo dos fotones extremadamente energéticos. En cambio, un fotón no puede distinguirse de un anti-fotón, pues dos fotones al ponerse en contacto no producen nuevos fotones, sino que prosiguen su existencia sin inmutarse: por esta razón, el fotón es una partícula que no posee antipartícula, o dicho más precisamente, es indistinguible de ella.

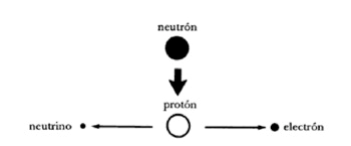

Figura 1. El decaimiento beta: un neutrón se transforma en un protón emitiendo un electrón y un neutrino.

En 1930, surgió una pequeña alarma por lo que podría ser una violación de la ley de conservación de la energía y, particularmente, de la fórmula E = mc2. El decaimiento beta es una reacción por la cual un neutrón se transforma en un protón, emitiendo un electrón; esta reacción es posible gracias a que la masa del neutrón es ligeramente superior a la del electrón, por lo que la diferencia de masa se transforma en la energía para crear el electrón emitido. Sin embargo, al estudiar el decaimiento beta, los físicos se dieron cuenta que el electrón resultante poseía siempre menos energía de la que se esperaría. Se llegó a sospechar que la fórmula de Einstein estaba equivocada, pero en 1930 el físico Wolfgang Pauli propuso una solución: la energía faltante se la llevaba una partícula hasta entonces desconocida, sin carga eléctrica y con masa nula o extremadamente pequeña. Tal partícula fue bautizada neutrino y su existencia fue confirmada varios años después, salvándose así la ley de conservación de la energía.

El neutrino es una partícula muy curiosa; se sabe en la actualidad que hay por lo menos dos tipos de neutrinos (muy probablemente tres y quizás más), con sus respectivos antineutrinos. La masa del neutrino parece ser exactamente cero, por lo que esta partícula viaja siempre a la velocidad de la luz, tal como el fotón. A diferencia de otras partículas, los neutrinos no tienen ninguna interacción con los fotones, razón por la que un neutrino y un antineutrino no se aniquilan al chocar, pues no pueden producir un par de fotones.

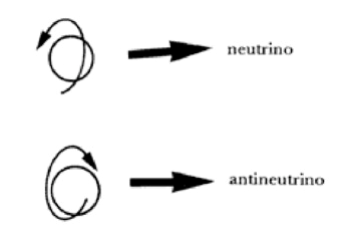

Figura 2. Sentido de rotación de un neutrino y un antineutrino con respecto a la dirección de su movimiento.

¿Cómo distinguir entonces un neutrino de un antineutrino, si ninguno tiene carga eléctrica? La respuesta es muy interesante: el neutrino, al igual que muchas otras partículas elementales, posee un momento angular, o dicho en palabras más simples, gira sobre sí mismo. Lo que distingue un neutrino de un antineutrino es el sentido en el que giran. Esto se ilustra en la figura 2: vistas desde atrás con respecto a la dirección de su movimiento, un neutrino gira en sentido contrario al de las manecillas de un reloj y un antineutrino en el otro sentido. Sin embargo, podríamos pensar que si nos movemos más rápido que un neutrino, lo veríamos moverse en sentido contrario girando como si fuera un antineutrino... ¡Pero recordemos que los neutrinos se mueven a la velocidad de la luz, por lo que es imposible rebasarlos!

Debido al límite natural que representa la velocidad de la luz, la distinción entre neutrinos y antineutrinos tiene un sentido físico muy claro. Otras partículas siguieron apareciendo en escena. En 1935, el físico japonés Hideki Yukawa propuso la existencia de ciertas partículas, que llamaron mesones, para explicar la fuerza nuclear entre protones y neutrones. Los mesones fueron descubiertos una década después. En los años cincuenta, los físicos habían descubierto todo un zoológico de partículas elementales con masas muy diversas, aunque casi todas eran inestables y se transformaban rápidamente en otras partículas. La única regularidad que se podía notar entre ellas era la carga eléctrica, que siempre es un múltiplo, positivo o negativo, de la carga del electrón. Parecía existir, pues, en la Naturaleza una unidad fundamental de carga eléctrica10: el electrón posee una unidad negativa y el protón una unidad positiva; los mesones pueden tener tanto carga positiva como negativa; algunas partículas como el neutrón, el neutrino y el fotón, poseen carga cero, mientras que otras partículas más raras tienen dos o más unidades de carga.

Para poner un poco de orden en la familia de las partículas elementales, el físico estadounidense Murray Gell-Mann sugirió en los años sesenta que las partículas como los mesones, protones, neutrones y otras más pesadas están constituidas por partículas aún más elementales, a las que bautizó cuark. La carga de los cuarks debe ser un tercio o dos tercios de la unidad fundamental de carga, con lo que se pueden explicar las propiedades básicas de las partículas elementales: Por ejemplo, el protón está formado por dos cuarks con carga +2/3 y uno con carga - 1/3, dando una carga neta igual a una unidad; el neutrón consta de dos cuarks con carga -1/3 y uno con carga +2/3, siendo la carga total nula; en cuanto a los mesones, están formados por parejas de cuarks y anti-cuarks, por lo que se desintegran rápidamente en el estado libre.

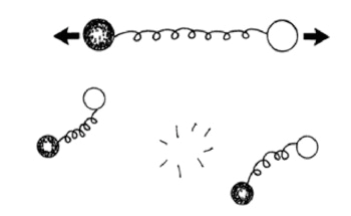

El modelo propuesto por Gell-Mann era muy ingenioso, y muchos datos experimentales lo confirmaban, excepto el hecho que nadie podía detectar un cuark. Durante años, los físicos trataron de encontrar cuarks aislados en estado natural, sin tener éxito, hasta que se dieron cuenta que los cuarks no pueden existir solos. La razón es que los cuarks se encuentran unidos entre si con una fuerza enorme que, además, aumenta con la distancia. Al contrario de la fuerza eléctrica o la gravitacional, que disminuyen al aumentar la distancia entre los cuerpos que se atraen, los cuarks están ligados entre sí por una interacción que aumenta con la separación, tal como un resorte que, mientras más se estira, atrae con mayor fuerza. La analogía del resorte puede ilustrar la razón por la que los cuarks no existen aislados. Supongamos que queremos separar dos cuarks ligados entre sí; podemos estirar el resorte que los une más y más hasta que se rompe. Pero para romper un resorte, hay que invertir energía. En el caso de los cuarks esta energía es tan grande que puede transformarse en la masa de dos nuevos cuarks. El resultado es que, al romperse el resorte, se producen dos parejas de cuarks en lugar de dos cuarks aislados, tal como se ilustra en la figura 3.

Figura 3. La interacción entre los cuarks es análoga a un resorte. La energía almacenada en el resorte permite crear un par de cuarks.

Hoy en día, los físicos piensan que los constituyentes básicos de la materia son los cuarks, por una parte, y los llamados leptones (partículas ligeras como el electrón y el neutrino) por la otra. Éstas se estudian en los aceleradores de partículas, donde alcanzan velocidades muy cercanas a la de la luz, gracias a las enormes cantidades de energías invertidas. Al chocar entre sí, las partículas forman nuevas partículas. La comprensión de estos fenómenos ha sido posible gracias a la unión de las dos grandes teorías de la física moderna.

Relatividad y Gravitación

Según el principio básico de la teoría de la relatividad, los fenómenos físicos obedecen leyes que no dependen del sistema de referencia desde el cual se observan. Pero este postulado, tal como hemos visto hasta ahora, se aplica sólo a sistemas inerciales, aquellos que se mueven en línea recta y a velocidad constante. Por el contrario, en un sistema no inercial (como un vehículo que forma una curva o se enfrena) actúan fuerzas que permiten discernir, el movimiento. Y sobre la superficie de la Tierra se puede distinguir entre arriba y abajo observando simplemente la caída de un cuerpo. En realidad, un sistema de referencia inercial perfecto debe estar aislado en el espacio sideral, lejos de cualquier cuerpo que lo atraiga gravitacionalmente.

Para superar estas limitaciones, Einstein investigó durante varios años la posibilidad de modificar la teoría de la gravitación de Newton para hacerla compatible con el principio de relatividad. La clave para él fue la existencia de una profunda relación entre fuerzas inerciales y fuerzas gravitacionales, Citemos sus propias palabras:

"Estaba yo sentado en mi sillón de la oficina de patentes de Berna cuando de repente tuve una ocurrencia: Si una persona cae libremente no siente su propio peso. Quedé atónito. Esta idea tan simple me impresionó profundamente. Me impulsó hacia una teoría de la gravitación. "

La teoría de la gravitación de Einstein empezó a tomar forma en 1907, cuando aún trabajaba en Berna, hasta culminar en su versión definitiva en 1916: la teoría general de la relatividad. La versión primera de la relatividad, aquélla que hemos discutido hasta ahora y que se restringe a sistemas de referencia inerciales, se conoce como la teoría restringida de la relatividad o también, teoría especial de la relatividad. La piedra angular de la relatividad general es un principio físico que nos remonta una vez más al mismísimo Galileo.

El principio de equivalencia

En la física aristotélica, se creía que los cuerpos pesados caían más rápidamente que los cuerpos ligeros. Cuenta una famosa, leyenda (que bien puede ser verídica) que Galileo Galilei demostró lo contrario al soltar simultáneamente desde lo alto de la Torre de Pisa dos piedras de peso desigual; ante la mirada del público incrédulo, las dos piedras llegaron al suelo exactamente al mismo tiempo (Figura 4). Así, Galileo comprobó que la trayectoria de un cuerpo bajo el influjo gravitacional de la Tierra es independiente de la masa del cuerpo. (En todo caso el movimiento puede depender de la forma del cuerpo, pero únicamente por la resistencia que le opone el aire. Es cierto que una pluma cae más lentamente que una bola de plomo, pero esto se debe exclusivamente a que el aire retarda la caída de la pluma. En una campana al vacío o en la Luna, donde no hay atmósfera; la pluma y la bola de plomo caen exactamente con la misma velocidad.)

En términos más precisos, lo que Galileo demostró fue la equivalencia entre la masa inercial y la masa gravitacional. Expliquemos a continuación estos dos conceptos, que muchas veces se confunden.

Figura 4. El experimento de Galileo.

La masa es una medida de la cantidad de materia (y energía, de acuerdo con la relatividad) que contiene un cuerpo. La Tierra atrae gravitacionalmente a los cuerpos masivos con una fuerza proporcional a su masa (como descubrió Newton), así que la manera más común de determinar la masa de un cuerpo consiste en medir esa fuerza gravitacional; de aquí el concepto del peso, que es en realidad una medida de la fuerza gravitacional ejercida por la Tierra sobre el objeto pesado. Pero no hay que olvidar que la atracción gravitacional depende también de la masa del cuerpo que atrae y disminuye con la distancia: por convención, la masa y el peso de un cuerpo se toman como iguales a nivel del mar. Una bolsa de pan que pesa un kilogramo a nivel del mar, será un gramo más liviana a 3.000 metros de altura, pesaría sólo 165 gramos sobre la superficie de la Luna, y no pesa nada en el espacio extraterrestre lejos de cuerpos que la atraigan.

Pero existe una segunda manera de determinar la masa de un cuerpo, y es por medio de la segunda ley de Newton, según la cual un cuerpo adquiere una aceleración directamente proporcional a la fuerza que se le aplica e inversamente proporcional a su masa. Si empujamos con la misma fuerza un carro que pesa 10 kilogramos y otro que pesa 100 kilogramos, el primero se acelerará 10 veces más que el segundo, de donde podemos deducir que el primer carro es 10 veces menos masivo, que el segundo.

Así, existen dos maneras de determinar la masa de un cuerpo. Una es con la que se mide la masa gravitacional. Otra forma es utilizar la segunda ley de Newton: midiendo la inercia que un cuerpo opone a la fuerza que se le aplique, con lo que se determina la masa inercial. Ahora bien, un principio básico, al que nos hemos acostumbrado tanto que nos parece evidente, es que la masa inercial y la masa gravitacional de cualquier cuerpo son iguales. Este es el principio de equivalencia que Galileo formuló por primera vez y que Einstein utilizó como fundamento de su teoría de la relatividad general.

¿Qué tiene de sorprendente que la masa inercial y la masa gravitacional sean iguales? Para aclarar este punto recordemos que la fuerza gravitacional es sólo una de las fuerzas de la Naturaleza. La fuerza electromagnética es muy distinta de la gravitacional y es la responsable que los cuerpos cargados eléctricamente se atraigan o se rechacen, o que los electrones de los átomos permanezcan unidos a los núcleos atómicos. Existen también otras fuerzas que actúan sólo a distancias subatómicas: la nuclear, que mantiene unidos los protones y neutrones en un núcleo, y débil, que produce el decaimiento beta.

Imaginemos ahora un planeta que posee una carga eléctrica y que, por lo tanto, atrae a los cuerpos en su superficie con una fuerza eléctrica, y no gravitacional. Un Galileo de ese planeta podría repetir el experimento de lanzar dos piedras con cargas eléctricas distintas y preguntarse ¿caerán al mismo tiempo? La respuesta es negativa, porque además de la carga influye la masa inercial en el movimiento de un cuerpo. Si dos piedras tienen la misma carga eléctrica; pero la masa inercial de una es de un gramo y la de otra es de una tonelada, la que se moverá más rápidamente al ser atraída por otra carga será evidentemente la más ligera.

El origen de la confusión entre masa inercial y gravitación es que nos hemos acostumbrado a llamar masa gravitacional a lo que en realidad es la carga gravitacional. Una diferencia fundamental entre la fuerza gravitacional y la electromagnética es que se puede cargar o descargar eléctricamente un cuerpo, pero la carga gravitacional de un cuerpo está fijada por su masa inercial y no se puede descargar gravitacionalmente (excepto en las películas de ciencia ficción donde vemos cuerpos masivos desafiando a la gravedad junto a otros que caen normalmente).

La implicación más inmediata del principio de equivalencia es que todos los cuerpos caen de la misma forma, independientemente de la masa que posean. El mismo Isaac Newton confirmó experimentalmente este principio antes de publicar las leyes de la mecánica que había descubierto. El experimento de Newton, más preciso que el realizado por Galileo en Pisa, consistió en medir el periodo de oscilación de varios péndulos de distintos pesos y materiales: después de un largo tiempo, los péndulos, cuyo movimiento se había sincronizado inercialmente, seguían oscilando con el mismo periodo. Y tres siglos después de los experimentos de Galileo y Newton, el principio de equivalencia se confirmó con técnicas modernas, con un margen de error de apenas una parte en un millón de millones.

La equivalencia entre masa (o carga) gravitacional y masa inercial es un principio básico de la naturaleza, cuyo origen aún estamos lejos de comprender. A finales del siglo XIX, el físico alemán Ernst Mach propuso que la masa inercial de un cuerpo está enteramente determinada por la atracción gravitacional de todos los demás cuerpos en el Universo, de donde la relación entre inercia y gravitación. Una conjetura muy interesante que no se ha podido todavía demostrar (o refutar), pero que inspiró a Einstein para fundamentar su teoría de la relatividad general.

Las cajas de Einstein

Existe una relación muy profunda entre sistemas de referencia no inerciales y sistemas de referencia sometidos a fuerzas gravitacionales, relación que se puede entender con un ejemplo dado por el mismo Einstein. Supongamos que nos encontramos encerrados en una caja colocada sobre la superficie terrestre. En su interior, sentimos la fuerza gravitacional de la Tierra que nos atrae al suelo, al igual que todos los cuerpos que se encuentran a nuestro alrededor. Al soltar una piedra, ésta cae al suelo aumentando continuamente su velocidad, es decir acelerándose a razón de 9.81 metros por segundo cada segundo, lo que equivale, por definición, a una aceleración de 1 g. Por supuesto, en el interior de la caja la fuerza que actúa sobre un cuerpo es proporcional a su masa gravitacional (Figura 5).

Figura 5. El pasajero en un vehículo que cae libremente no siente ninguna fuerza gravitacional.

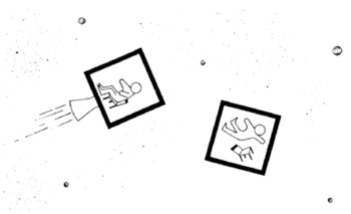

Ahora, consideramos el caso de una caja situada en el espacio, lejos de la influencia gravitacional de cualquier planeta o estrella. Si esa caja está en reposo, todo lo que se encuentra en su interior flota ingrávidamente. Pero si la caja se acelera, aumentado su velocidad a razón de 9.81 metros por segundo cada segundo (1 g), los objetos en su interior se quedan rezagados y se pegan al suelo; más aún, un cuerpo que se suelte dentro de ella se dirigirá al suelo con una aceleración de 1 g. Evidentemente, la caja acelerada es un sistema de referencia no inercial, y las fuerzas, que aparecen en su interior son fuerzas inerciales que dependen de la masa inercial de los cuerpos sobre los que actúan (Figura 6).

Figura 6. El pasajero en un vehículo acelerado puede pensar que un planeta lo atrae gravitacionalmente.

Y ahora la pregunta fundamental: ¿pueden los ocupantes de una caja determinar por medio de experimentos físicos si se encuentran en reposo sobre la superficie de la Tierra o se encuentran en el espacio, en movimiento acelerado? La respuesta es no, porque el principio de equivalencia no permite distinguir, dentro de la caja, entre una fuerza gravitacional y una inercial. Podemos imaginamos otra posible situación. Esta vez la caja es un elevador que se encuentra en un edificio terrestre, pero su cable se rompe y cae libremente. Sus ocupantes caen junto con la caja y, mientras dura la caída, no sienten, ninguna fuerza gravitacional, exactamente como si estuvieran en el espacio extraterrestre.

Otra situación, que se ha vuelto familiar en los últimos años, es la de los cosmonautas que vemos flotar ingrávidos dentro de sus vehículos colocados en órbita alrededor de la Tierra. Si no perciben ninguna fuerza, gravitacional no es porque estén tan alejados de la Tierra que no resientan su atracción, es porque el vehículo espacial y sus tripulantes se encuentran en caída libre. Esto puede no coincidir con la idea, común de Luna caída; pero hay que recordar que, estrictamente hablando, un cuerpo se encuentra en caída libre si se mueve únicamente bajo el influjo de una fuerza gravitacional sin otro tipo de restricción. Un satélite terrestre efectivamente está en caída libre, pero nunca choca con la Tierra por la curvatura de ésta, como se puede ver en la figura 7.

Figura 7. Un satélite en órbita es un caso extremo de proyectil de caída libre.

En resumen, un vehículo espacial en órbita, con sus motores apagados y sin fricción del aire por encontrarse fuera de la atmósfera, es un ejemplo perfecto de un sistema inercial: sus ocupantes no pueden, decidir, sin mirar por las escotillas, si están en órbita alrededor de la Tierra o en reposo lejos de todo cuerpo celeste. Así, un sistema de referencia inercial es equivalente a un sistema de referencia en caída libre, y del mismo modo un sistema no inercial es equivalente a un sistema de referencia sometido a la fuerza gravitacional. En consecuencia, se puede extender el principio de relatividad a sistemas no inerciales si se toma en cuenta a la gravitación. Pero Einstein fue más allá de esta simple comprobación.

Figura 8. Manifestación de la fuerza gravitacional en una caja en caída libre suficientemente grande.

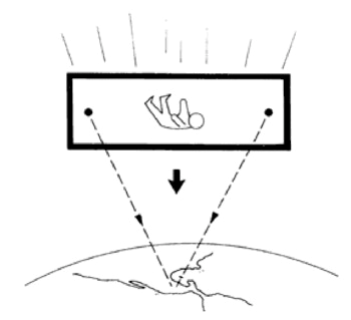

Regresemos al ejemplo de la caja en caída libre, pero esta vez supongamos que la caja es lo suficientemente grande para hacer el siguiente experimento: colóquense dos canicas en cada extremo del compartimiento, como se indica en la figura 8. Como las canicas se hallan también en caída libre, permanecen fijas, flotando, para los ocupantes de la caja. Sin embargo, las trayectorias de ambas no son exactamente rectas paralelas, sino rectas que convergen al centro de la Tierra. En consecuencia, vistas desde la caja, las dos canicas no están estrictamente fijas, sino que parecen acercarse lentamente una a otra. Este efecto casi imperceptible no ocurriría si la caja estuviera en el espacio extraterrestre, lejos de todo influjo gravitacional, ya que las dos canicas permanecerían exactamente donde se colocan.

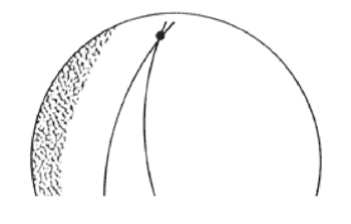

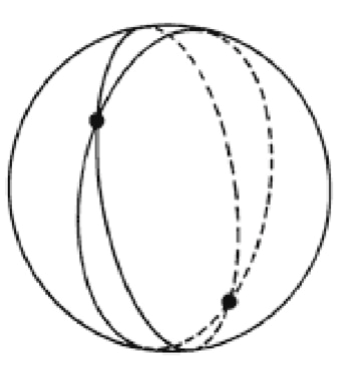

El experimento anterior implica que la equivalencia entre sistema inercial y sistema en caída libre debe formularse con más precisión: Los dos sistemas son equivalentes en una región pequeña del espacio, pero pueden distinguirse uno del otro si se realizan experimentos físicos sobre distancias suficientemente grandes. Esta comprobación condujo a Einstein a relacionar la gravitación con las propiedades geométricas de una superficie. Por ejemplo, sabemos que la Tierra es redonda, pero su curvatura no se manifiesta en una región pequeña; a escala humana, nuestro planeta parece plano y es sólo sobre distancias de varios cientos de kilómetros que los efectos de la curvatura se vuelven apreciables. Si se trazan dos rectas paralelas sobre la superficie terrestre, estas rectas permanecen paralelas inicialmente manteniéndose constante la distancia entre ellas; pero si las rectas se prolongan cientos de kilómetros empezarán a converger debido a la curvatura de la Tierra, y acabaran por unirse en algún punto (Figura 9).

Figura 9. Dos “paralelas” terminan uniéndose sobre una superficie curva.

Las rectas trazadas sobre la superficie de la Tierra son más bien segmentos de círculo; es sólo a escalas pequeñas que parecen rectas.

Figura 10. Las geodésicas son las curvas de menor longitud sobre una superficie curva.

El concepto de recta pierde su sentido sobre una superficie curva y es más preciso referirse a curvas de longitud mínima: sobre una superficie plana, la recta es la curva de mínima longitud entre dos puntos dados, pero sobre la superficie de una esfera la curva más corta entre dos puntos es un segmento de círculo (Figura 10). Ahora bien, las dos paralelas trazadas sobre la superficie de la Tierra, y que terminan por unirse debido a la curvatura de ésta, recuerdan las trayectorias de las dos canicas en el elevador que cae. En el primer caso, se tiene un efecto debido a la curvatura de una superficie, mientras que en el segundo caso se manifiesta una fuerza gravitacional. El primer efecto es geométrico y el segundo gravitacional. Una superficie curva parece plana en una región suficientemente pequeña, y del mismo modo una fuerza gravitacional no es detectable en un vehículo de dimensiones reducidas y en caída libre.

Todas estas analogías condujeron a Einstein a la conclusión que la fuerza gravitacional puede interpretarse como un efecto geométrico. Sólo que, a diferencia de la superficie terrestre, en la teoría de Einstein el espacio-tiempo es curvo y la gravitación es la manifestación de su curvatura.

La curvatura del espacio-tiempo

Consideremos primero el caso más simple de un espacio curvo de dos dimensiones. Un ejemplo es la superficie de una esfera, que es de dos dimensiones porque se necesitan dos números, las coordenadas de longitud y latitud, para localizar un punto sobre ella. Las curvas de menor longitud entre dos, puntos son el equivalente de las rectas y se llaman en lenguaje matemático, geodésicas. A diferencia de las rectas sobre una superficie plana, dos geodésicas inicialmente paralelas se cruzan en algún punto (Figura 10); en general, los postulados y teoremas de la geometría elemental, que se aprende en la escuela, no son válidos sobre superficies curvas donde las geodésicas sustituyen a las rectas.

A mediados del siglo XIX, el matemático alemán Georg Friedrich Bernhard Riemann (1826-1866) tuvo la idea de extender el concepto de superficie curva a un espacio con cualquier número de dimensiones. En un espacio así, cada punto está determinado por medio de n coordenadas; más aún, se puede postular una fórmula para medir la distancia entre dos puntos, lo cual permite construir geodésicas, que sustituyen a las rectas en el espacio ordinario. Es evidente que, en un espacio curvo los postulados y teoremas básicos de la geometría clásica no se cumplen las geodésicas pueden cruzarse en más de un punto, las paralelas no mantienen constante la distancia entre ellas, la suma de los ángulos de un triángulo no da 1800, etcétera.

Riemann demostró que las propiedades básicas de un espacio curvo están determinadas exclusivamente por la fórmula para medir distancias. Escoger una manera de medir esta distancia equivale a definir un espacio riemanniano, que es un espacio curvo de dos, tres, cuatro o cualquier número de dimensiones. A diferencia de las superficies, que son espacios de dos dimensiones, los espacios curvos de tres o más dimensiones no se pueden visualizar. Sin embargo, es posible definirlos y manejarlos matemáticamente sin ninguna dificultad de principio; los espacios riemannianos son un excelente ejemplo de un concepto que sólo se puede describir en lenguaje matemático. Como una visión profética, Riemann especuló que podría existir una relación entre las propiedades geométricas del espacio y los procesos físicos que ocurren en él. Sin embargo, sus trabajos fueron considerados durante mucho tiempo como simples curiosidades matemáticas, ajenas al mundo real. No fue sino hasta la segunda década del siglo XX cuando Einstein llegó a la conclusión que el espacio tiempo en el que vivimos es un espacio de cuatro dimensiones.

Einstein publicó la versión definitiva de su teoría de la relatividad general en el número de noviembre de 1915 del Boletín de la Academia de Ciencias de Berlín, en plena primera Guerra Mundial. Para la formulación de esta teoría contó con la ayuda de su amigo el matemático Marcel Grossman, quien le había despertado el interés en los trabajos de Riemann. La esencia de la teoría de Einstein es que la masa de un cuerpo deforma el espacio-tiempo a su alrededor. En ausencia de masa, el espacio-tiempo es plano y una partícula se mueve en línea recta porque nada influye sobre su trayectoria, pero en presencia de una masa gravitante, el espacio-tiempo se curva y una partícula se mueve a lo largo de una geodésica. De acuerdo, con esta interpretación de la gravedad, un planeta gira alrededor del Sol porque sigue una trayectoria geodésica en el espacio-tiempo deformado por la masa solar.

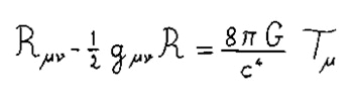

En la teoría de la gravitación de Newton, se puede calcular la atracción gravitacional ejercida por una distribución dada de masa por medio de una ecuación matemática. En la teoría de Einstein, se calcula la curvatura del espacio-tiempo, pero la situación es bastante más complicada porque no sólo la masa, sino también, la energía ejerce una acción gravitacional. En su artículo de 1916, Einstein dedujo la ecuación matemática que relaciona la geometría del espacio-tiempo con la distribución de masa y energía: esta fórmula se conoce como ecuación de Einstein y es la base de la relatividad general (Figura 11).

Figura 11. La ecuación de Einstein de la relatividad general.

Si los físicos no se habían percatado antes de Einstein que el espacio es curvo es porque la gravedad de la Tierra y del Sol induce una curvatura extremadamente leve. La situación es semejante a la de los hombres antiguos que creían que la Tierra era plana, ya que su curvatura es imperceptible a pequeña escala. Como veremos a continuación, la curvatura del espacio-tiempo se manifiesta plenamente a la escala del Universo mismo, o cerca de cuerpos celestes cuya atracción gravitacional es extremadamente intensa. En nuestro Sistema Solar, debemos conformarnos con efectos casi imperceptibles para confirmar la relatividad general.

Figura 12. Einstein en Estados Unidos.

LA GRAVITACIÓN EN EL UNIVERSO

Así como una canica desvía su trayectoria sobre una superficie curvada, una partícula masiva o un fotón siguen una geodésica en el espacio-tiempo curvo. Las ecuaciones matemáticas de la relatividad general permiten calcular la curvatura del espacio-tiempo producida por una masa dada, así como las trayectorias de las partículas bajo la influencia de esa masa. En la práctica, este cálculo es un proceso difícil. Al principio, Einstein logró resolver sus ecuaciones en forma aproximada y, aún así, obtuvo resultados sumamente interesantes, que veremos a continuación. Posteriormente, se encontraron algunas otras soluciones exactas: unas describen cuerpos muy compactos y otras son modelos del Universo.

El movimiento del perihelio de mercurio

El primer gran éxito de Newton fue explicar el movimiento de los planetas alrededor del Sol. Tomando en cuenta, sólo la atracción gravitacional del Sol, demostró que las órbitas de los planetas son elipses, tal como había descubierto Kepler en forma empírica. Sin embargo, la atracción de los planetas entre sí, aunque mucho menor que la atracción solar, no es enteramente despreciable y produce ligeras desviaciones en las órbitas planetarias. Estas pequeñas perturbaciones orbitales se han podido calcular y las observaciones confirman los resultados teóricos. De hecho fue así como en el siglo pasado los astrónomos Adams y Le Verrier predijeron la existencia y la posición en el cielo del planeta. Neptuno a partir de las perturbaciones observadas en la órbita de Urano, el planeta más lejano conocido en aquella época.

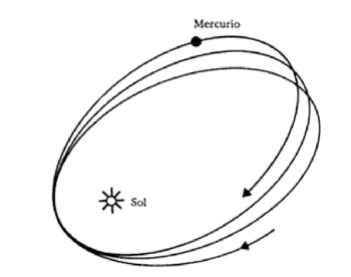

El mismo Le Verrier fue quien descubrió por primera vez una anomalía en la órbita de Mercurio, el planeta más cercano al Sol. En 1859, anunció que el perihelio’11 de Mercurio avanza 38 segundos de arco por siglo (Figura 13). Este fenómeno fue confirmado posteriormente por otros astrónomos, estableciéndose un valor de 43 segundos por siglo, que es el aceptado en la actualidad. Le Verrier reconoció que el fenómeno que había descubierto no tenía una explicación simple. Descartó la posibilidad que se debiera a la influencia de Venus o de algún planeta, aún no descubierto, que se encontrara en órbita entre Sol y Mercurio. Sugirió como posible explicación la presencia de una nube de asteroides en órbita intra-mercurial, pero ningún astrónomo detectó tales cuerpos. El avance del perihelio de Mercurio fue durante años una espina clavada en la mecánica newtoniana, pues arrojaba la sombra de la duda sobre la perfección de esta teoría.

Figura 13. Corrimiento del perihelio de Mercurio.

En noviembre de 1915, Einstein trabajaba en la versión final de su artículo sobre la relatividad general. La primera aplicación que hizo de su teoría fue calcular la órbita de un planeta alrededor del Sol, y demostrar que, debido a efectos relativistas, el perihelio de las órbitas se corre lentamente. En particular, el resultado que obtuvo para el caso de Mercurio fue de ¡43 segundos por siglo!, en total acuerdo con las observaciones astronómicas. Así Einstein resolvió un problema que mantuvo en jaque a los mecánicos celestes durante seis décadas. Según contó él mismo, durante los días posteriores a su descubrimiento estuvo fuera de sí por la emoción y llegó a sufrir taquicardia.

La desviación de la luz

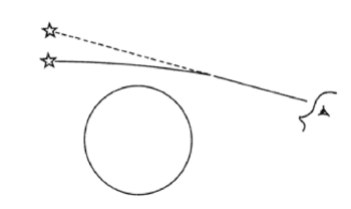

¿Actúa la fuerza gravitacional sobre la luz como sobre cualquier partícula material? ¿Es la luz inmune a la gravedad? Isaac Newton pensaba que la luz está constituida por partículas y que por lo tanto un rayo luminoso debe desviarse bajo la acción de la gravedad, al igual que la trayectoria de un proyectil (aunque, esta desviación debe ser prácticamente imperceptible debido a la enorme velocidad de la luz). Ya en 1911, Einstein, aun cuando no había formulado por completo su teoría de la gravitación, postuló que la luz se comporta como cualquier partícula material. Por lo tanto, predijo que un rayo de luz al pasar, cerca de la superficie del Sol desvía su trayectoria en un ángulo de 0.87 segundos de arco (Figura 14) y propuso medir ese efecto durante un eclipse solar.

Figura 14. Desviación de la luz al pasar cerca del sol.

El ángulo de desviación se puede calcular según la mecánica newtoniana invocando el principio de equivalencia, pues la trayectoria de una partícula atraída gravitacionalmente no depende de su masa. De acuerdo con esta suposición, la masa de una partícula de luz, un fotón, carecería de importancia en el cálculo de su trayectoria. Sin embargo, en 1915, con la teoría de la relatividad general bien establecida, Einstein volvió a calcular la desviación de un rayo de luz y se dio cuenta que la curvatura del espacio-tiempo y el hecho que la masa del fotón es estrictamente cero, influyen en forma muy particular sobre la trayectoria de la luz. Esta vez dedujo que un rayo de luz debe desviarse en un ángulo de 1.7 segundos al pasar cerca del Sol, exactamente el doble de lo que predice la teoría newtoniana. Así, midiendo ese ángulo se puede comprobar cuál teoría, la de Newton o la de Einstein, es la correcta en el caso de la luz.

El experimento propuesto por Einstein consistía en observar las estrellas muy cerca del disco solar durante un eclipse total de Sol, única oportunidad de ver las estrellas cerca de este astro. Comparando la posición aparente de una estrella con la que tenía cuando el Sol no se hallaba cerca, se puede determinar el ángulo de desviación, aunque este ángulo es tan pequeño que su medición es muy difícil y requiere de una enorme precisión. Al parecer, el primer intento de confirmar las ideas de Einstein lo realizó una expedición argentina que partió a observar un eclipse en Brasil, en 1912, pero tuvo la mala suerte de encontrar tiempo totalmente nublado. Otra expedición, esta vez alemana, se dirigió a Crimea, en 1914, para observar un eclipse visible desde esa región, pero fue sorprendida por la declaración de guerra entre Alemania y Rusia, por lo que los miembros de la expedición tuvieron que regresar apresuradamente sin presenciar el fenómeno celeste.

La primera Guerra Mundial impidió cualquier intento, de medir el efecto calculado por Einstein. Finalmente, en 1919, ya concluida la guerra, se organizaron dos expediciones británicas para observar un eclipse que tendría lugar el 29 de mayo de ese año. La primera expedición, dirigida por Andrew Crommelin, se instaló en Brasil, y la segunda, a cargo de sir Arthur Eddington, se estableció en una isla frente a la Guinea Española. Esta vez, las observaciones fueron exitosas. En una sesión científica que tuvo lugar en Londres en noviembre del mismo año, y en medio de enormes expectativas, Crommelin y Eddington anunciaron finalmente el resultado de varios meses de estudio de sus placas fotográficas: dentro de los posibles errores de medición, se confirmaba el valor predicho por la relatividad general. A partir de ese día, Einstein se volvió una figura pública.

La medición de 1919 tenía un margen de error de un 30%. Se han repetido observaciones durante otros eclipses con precisiones de hasta 10% confirmando la predicción de Einstein. En años más recientes, los astrónomos utilizaron, en lugar de estrellas, fuentes cósmicas de radio (algunas galaxias y cuásares emiten no sólo luz visible sino también ondas de radio), con el fin de medir la desviación de las señales de radio al pasar cerca del Sol. La ventaja de este método es que las fuentes de radio en el cielo se pueden detectar también de día y cerca del Sol, por lo que no es necesario esperar un eclipse. Los resultados más recientes han confirmado la teoría de Einstein con una precisión de 1%.

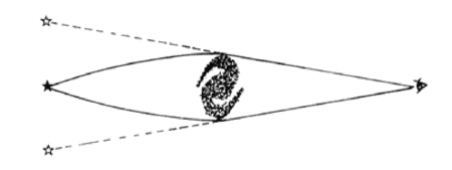

Una comprobación más espectacular que la luz se desvía por la gravedad surgió en 1979, con el descubrimiento de las lentes gravitacionales. Los cuásares son los objetos más lejanos y luminosos que se pueden observar en el Universo. En algunas ocasiones, la luz emitida por un cuasar puede pasar muy cerca o a través de una galaxia que se encuentra a medio camino entre el cuasar y nosotros, la cual desvía la luz, como si fuera una lente gravitacional. En ese caso, puede ocurrir que la luz del cuasar pase tanto de un lado como del otro de la galaxia (Figura 15), y, como resultado, el cuasar se observe doble.

Figura 15. Efecto de lente gravitacional por el que se desdobla la imagen de un objeto lejano.

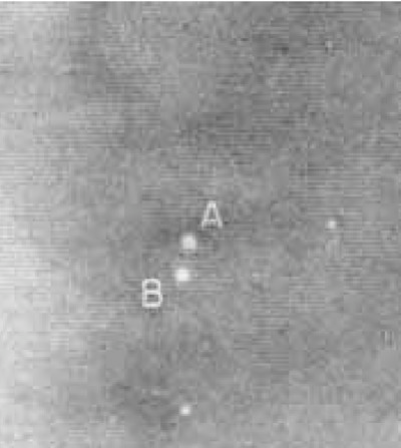

En 1979, astrónomos estadounidenses detectaron un cuasar doble, con dos componentes idénticas entre sí excepto por el tamaño, y dedujeron que se trataba del mismo cuasar observado a través de una galaxia actuando como lente gravitacional (Figura 16). Esa galaxia, menos luminosa que el cuasar, fue detectada posteriormente. Desde entonces se han encontrado cerca de una decena de cuásares dobles.

Figura 16. El cuasar doble.

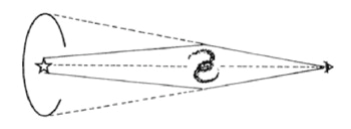

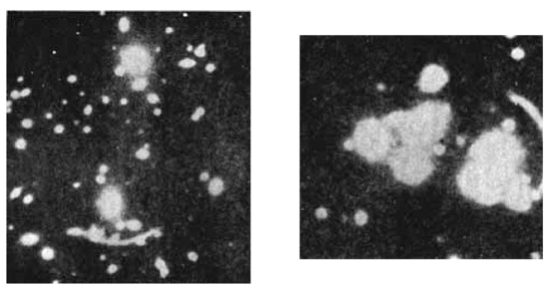

Un caso extremo de este efecto es cuando el cuasar, la galaxia intermedia y la Tierra se encuentran perfectamente alineados. Cuando esto sucede, la imagen del cuasar ya no es doble sino que se distribuye a lo largo de un arco, como se ve en la figura 16. Lo interesante es que en 1985 se detectó un gigantesco arco luminoso alrededor de una galaxia (Figura 17); algunos astrónomos sospechan que se trata de la imagen de un cuasar lejano amplificado y deformado por una galaxia alineada en forma excepcional.

Figura 17. Formación de un arco por una lente gravitacional.

El corrimiento al rojo

Cuando se arroja una piedra hacia arriba, llega a cierta altura con una velocidad menor que la inicial. Dicho de otro modo, la piedra tiene que gastar parte de su energía para subir en contra de la atracción gravitacional de la Tierra. ¿Sucede algo similar con la luz? En 1907, cuando Einstein apenas empezaba a interesarse en la gravitación, dedujo que un fotón debe perder parte de su energía para escaparse de la atracción gravitacional de un cuerpo masivo. Ahora bien, la energía de un fotón es proporcional a su frecuencia (o inversamente proporcional a su longitud de onda asociada), así que un fotón emitido desde la superficie del Sol, por ejemplo, llega al espacio con una frecuencia ligeramente menor, corrida hacia el lado rojo del espectro, que la que poseía inicialmente.

Figura 18. El famoso arco luminoso que podría deberse al efecto mostrado en la figura 17.

Einstein calculó primero este efecto en forma aproximada, recurriendo únicamente al principio de equivalencia. Años más tarde, con la teoría general de la relatividad bien establecida, dedujo el resultado exacto una vez más y confirmó su primer cálculo. Todos los átomos emiten fotones con frecuencias bien definidas, y estos fotones se pueden observar como líneas sobrepuestas al espectro. De acuerdo con Einstein, los fotones emitidos por los átomos en la superficie del Sol deben producir líneas espectrales corridas ligeramente hacia el lado rojo del espectro. Desgraciadamente, este efecto es demasiado pequeño en el caso del Sol para poderlo identificar sin lugar a dudas. Sin embargo, los astrónomos habían descubierto por esa época que la estrella Sirio posee una extraña compañera, cuya masa es semejante a la del Sol pero cuyo tamaño es extremadamente pequeño, de modo tal que la atracción gravitacional en su superficie es treinta veces más intensa que en la del Sol. Este hecho permitió detectar en 1924 el corrimiento al rojo en el espectro de esta estrella, confirmando la predicción de Einstein.

El corrimiento al rojo gravitacional resurgió en forma inesperada en los años sesenta, cuando los físicos estadounidenses R. V. Pound, G. A. Rebka y J. L. Snider realizaron un experimento tan preciso que pudieron medir el cambio de frecuencia de un fotón emitido desde el suelo hasta el techo de una torre, ¡a 22 metros, de altura! Utilizando el llamado efecto Móssbauer, por el que ciertos materiales emiten rayos gamma (fotones muy energéticos) con una frecuencia perfectamente bien definida, lograron confirmar la predicción de Einstein con un margen de error de sólo 1%, a pesar que el cambio en frecuencia es de apenas una parte en mil billones.

Agujeros negros

La compañera de Sirio es un ejemplo de una estrella que, al final de su evolución, se comprime bajo la fuerza de su propia gravedad y alcanza densidades enormes. En general, cuando una estrella agota su combustible nuclear, la presión interna ya no puede detener su contracción gravitacional. Después de una evolución final bastante complicada, que depende fundamentalmente de la masa de la estrella, ésta arroja al espacio una fracción considerable de su materia, ya sea, en forma lenta, si la masa de la estrella no excede unas seis veces la masa del Sol, ya sea en forma violenta, en una explosión de supernova, si la estrella es muy masiva.

En el primer, caso, la estrella se transforma en una enana blanca, como la compañera de Sirio. La masa de una enana blanca no puede exceder una vez y media la masa del Sol, como demostró en 1938 el astrofísico Chandrasekar. En el segundo caso, después de la explosión, la mayor parte de la masa estelar se extiende por el espacio y sólo queda el núcleo mismo de la estrella como remanente. Ese núcleo, dependiendo de su masa, se transforma en estrella de neutrones o en agujero negro.

Una estrella de neutrones tiene una masa algo superior a la del Sol, pero su radio es de apenas unos 10 kilómetros. En tales estrellas, la materia está tan comprimida que los protones y electrones originales se fusionan para formar neutrones. Un centímetro cúbico de una estrella de neutrones pesa unas cien millones de toneladas. Las estrellas de neutrones giran sobre sí mismas dando varias vueltas por segundo; esto junto con el hecho que poseen un campo magnético muy intenso, hace que emitan pulsos de radio con una periodicidad bien definida. Así es como los radioastrónomos las detectaron por primera vez y las llamaron pulsares.

Si la masa de una estrella de neutrones excede unas tres veces la del Sol, entonces la estrella sigue comprimiéndose indefinidamente por su propia atracción gravitacional. El resultado final será un hoyo negro, un cuerpo cuya fuerza gravitacional es tan intensa que nada, ni siquiera la luz, puede escapar de él. La existencia de los hoyos negros ha sido predicha por la teoría general de la relatividad y astrofísica moderna. Apenas unos meses después que Einstein presentara las ecuaciones básicas de su teoría general, el astrónomo alemán Karl Schwarzschild encontró una solución exacta de ellas que describía el espacio-tiempo alrededor de un cuerpo masivo esférico. Entre otras cosas, la solución de Schwarzschild implicaba que si un cuerpo esférico tiene una masa M y un radio igual o menor que

GM / 2c2

entonces la luz emitida de su superficie sufre un corrimiento infinito al rojo. Dicho de otro modo, un fotón no podría escapar de la superficie de tal cuerpo, pues toda su energía no sería suficiente para despegarse de él. El radio crítico predicho por Schwarzschild es de tres kilómetros para una masa igual a la del Sol. Es decir, si el Sol se comprimiera a ese tamaño, se volvería lo que ahora se llama un agujero negro. En los últimos años muchos astrofísicos se han convencido que las estrellas más masivas terminan sus días transformándose en agujeros negros. Estos objetos no pueden detectarse directamente, pero se manifiestan por los efectos de la enorme fuerza gravitacional a su alrededor. Por ejemplo, si un agujero negro se encuentra muy cerca de una estrella normal, succiona el gas de ésta; justo antes de penetrar al hoyo, el gas estelar se calienta a varios millones de grados y emite radiación en forma de rayos X. En años recientes se han detectado fuentes cósmicas de rayos X que, podrían corresponder a este proceso.

El universo en expansión

La relatividad general se aplicó también a la cosmología, el estudio físico del Universo. Con base en su teoría, el mismo Einstein propuso, en 1916, un modelo matemático del Universo. El Universo de Einstein era estático, finito de volumen pero sin fronteras, semejante a la superficie curva de un globo, pero en tres dimensiones espaciales, a diferencia de la superficie que sólo es bidimensional. Pocos, años después, el físico ruso Alexander Alexandrovich Fridman estudió las ecuaciones de la relatividad general y encontró unas soluciones que describen un universo en expansión, en el sentido que la distancia entre dos galaxias lejanas aumenta con el tiempo.

Al principio, Einstein pensó que la solución de Fridman no era realista. Pero en 1929, el astrónomo estadounidense Edwin Hubble anunció un descubrimiento que habría de revolucionar todas las concepciones sobre el Universo. Hubble descubrió que las galaxias se alejan unas de otras, con una velocidad proporcional a su separación, ¡tal como lo había predicho Fridman! La consecuencia inmediata del descubrimiento de Hubble es que el Universo se encuentra en un proceso de expansión. Extrapolando hacia el pasado, resulta que toda la materia del Universo se encontraba comprimida a una densidad prácticamente infinita en algún momento hace aproximadamente quince mil millones de años. A ese estado inicial del Universo, los físicos lo han llamado la Gran explosión. Según la teoría más aceptada actualmente, el Universo se encontraba a densidades y temperaturas extremadamente altas poco después de la Gran explosión, pero la materia cósmica se fue diluyendo y enfriando a medida que el Universo se expandía.

Según los cálculos de los físicos, tres minutos después de la Gran explosión la temperatura había bajado a mil millones de grados y se formaron los primeros núcleos atómicos. La teoría predice que la composición química del Universo en ese momento quedó fijada en aproximadamente 75% de hidrógeno, 25% de helio y apenas una traza de otros elementos. Lo interesante es que las observaciones astronómicas de galaxias lejanas confirman esta abundancia inicial, lo que se considera una prueba importante a favor de la teoría de la Gran explosión. El Universo siguió enfriándose y unos 300 000 años después de la Gran explosión la temperatura había bajado a 5 000 grados. A partir de ese momento los electrones, libres hasta entonces, se unieron a los núcleos y se formaron los primeros átomos.

Los electrones libres interactúan intensamente con los fotones, por lo que impiden el recorrido libre de éstos; pero los átomos no se oponen fuertemente al paso de la luz: en consecuencia, el Universo se volvió transparente cuando se formaron los átomos. En ese momento, todos los fotones quedaron libres y debe ser posible observarlos en la actualidad, a pesar que han perdido la mayor parte de su energía, debido a la expansión y enfriamiento del Universo. Estos fotones fósiles forman justamente la radiación de fondo, que fue descubierta por A. A. Penziar y R. W. Wilson en 1967, y corresponde a una temperatura actual del Universo de unos 2.7 grados Kelvin sobre el cero absoluto (que equivale a -273 grados Celsius).

La radiación de fondo es perfectamente uniforme y posee la misma intensidad en todas las direcciones en el cielo. En particular, permite definir un sistema, de referencia cósmico, con respecto al cual se pueden medir todos los movimientos en el Universo. Se ha descubierto recientemente, que nuestra Galaxia se mueve a una velocidad de 400 kilómetros por segundo con respecto a la radiación de fondo. El lector podrá pensar que la existencia de la radiación de fondo contradice el principio de relatividad, pues constituye un sistema de referencia absoluto. En realidad no es así el principio de relatividad estipula, que las leyes de la física son las mismas en cualquier sistema de referencia, sea éste el de la radiación de fondo o cualquier otro, pero no excluye que un sistema de referencia sea más conveniente que otro. La existencia de un sistema de referencia universal es muy apropiada para efectuar mediciones astronómicas a escala cósmica, pero no hay manera de determinar por experimentos físicos locales, encerrados en un laboratorio, si nos movemos con respecto a él. De otro modo, ya nos habríamos dado cuenta desde hace siglos que nos movemos a 400 kilómetros por segundo por el Universo.

El principio de la relatividad permanece incólume.

© 2026 JAVIER DE LUCAS